¿Es necesario tener consideraciones éticas en la implementación de la inteligencia artificial (en adelante, IA) dentro de la industria? O, son más bien estas mismas consideraciones éticas, una traba para explotar todos los beneficios que nos podría brindar esta tecnología, de cara al empresariado.

Estas interrogantes son tratadas en un reciente artículo escrito por Dharmesh Syal, Director de Tecnología BCG Digital Ventures, en el blog del Foro Económico Mundial (ver artículo líneas abajo). En él, Syal señala que, a la velocidad que van las empresas hoy en día en la adopción de nuevas tecnologías, es hasta cierto punto, poco competitivo discutir sobre si se debe implementar IA en algunas industrias, aún cuando existan implicancias éticas de por medio.

No olvidemos que Isaac Asimov propuso en 1950, en su libro: Yo Robot, las Tres Leyes de la Robótica:

- Un robot no puede hacer daño a un ser humano o, por inacción, permitir que un ser humano sufra daño.

- Un robot debe obedecer las órdenes dadas por los seres humanos, excepto si estas órdenes entrasen en conflicto con la primera Ley.

- Un robot debe proteger su propia existencia en la medida en que esta protección no entre en conflicto con la primera o la segunda Ley.

Syal es enfático también en señalar que “Las áreas en las que la IA nos beneficia más también tienen el mayor potencial de dañarnos”. Cuestiones que tienen que ver con el límite legal de las acciones de las máquinas y/o robots programados con IA en el ámbito de la salud por ejemplo, hasta el peligro de que pueda haber equivocaciones de esta tecnología en el uso de armas de guerra, son algunos de los ejemplos que propone el autor al respecto.

Ante ello, él considera que tales preocupaciones relacionadas al comportamiento “ético” de la IA pueden ser superadas basándose en 3 estrategias:

- Codificar las prácticas éticas en los metadatos de la IA para impulsar a largo plazo el “factor humano” en la toma de decisiones de las máquinas y/o robots programados con esta tecnología.

- Implementar medidas de seguridad en las redes, de manera que se asegure que no se viole la confianza de los consumidores, en particular, sus datos personales.

- Crear un código de ética que esté acorde a lo dictado por la forma en que las empresas usan IA. Esto es fundamental, en tanto el CEO tome en serio dichos estándares e irradie esta actitud hacia los demás trabajadores de menor jerarquía.

Se debe relevar que, desde Lampadia creemos que, como toda tecnología introducida por la 4ta Revolución Industrial (4IR), la IA permitirá volver más eficientes los procesos de mercado lo que, a la larga, mejorará la calidad de vida de la población mundial como lo hizo en su momento y lo sigue haciendo, la digitalización.

Sin embargo, considerando la propia naturaleza de la IA, la cual pretende a la larga, replicar las acciones del hombre en una serie de actividades económicas, sociales y hasta de índole militar, consideramos que las propuestas de Syal son sensatas, sobretodo porque, de ser correctamente implementadas, pueden aplacar la creciente preocupación que está generando esta nueva tecnología en torno a la ética. No puede descartarse el uso de la IA, dado que aún no ha mostrado todo su potencial. Lampadia

Es hora de dejar de hablar de ética en la IA y comenzar a tenerla

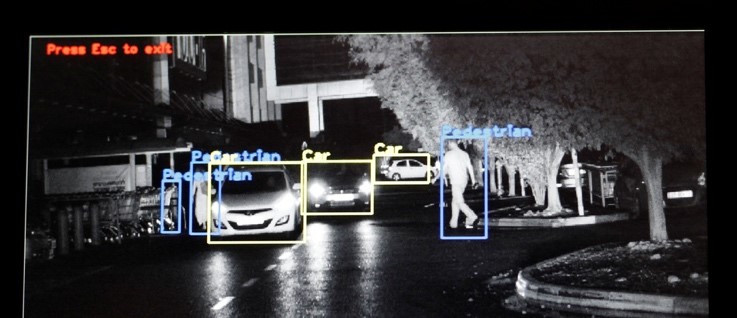

La carrera para construir el primer vehículo totalmente autónomo ha planteado cuestiones

éticas en primer plano. Imagen: REUTERS/Amir Cohen

Dharmesh Syal

Director de Tecnología

BCG Digital Ventures

Foro Económico Mundial

17 de Enero, 2019

Traducido y glosado por Lampadia

Todos, desde Stephen Hawking a Bill Gates y Elon Musk, han discutido la filosofía de la inteligencia artificial (IA). Ahora que las compañías de todo el mundo están creando productos de IA a un ritmo increíble, es cada vez más urgente que dejemos de hablar sobre cómo implementar salvaguardas éticas en IA y comenzar a hacerla.

La carrera para construir el primer vehículo totalmente autónomo (AV) ha llevado este tema al frente y al centro. La muerte de un peatón en marzo ha generado preocupación no solo por la seguridad de los AV, sino también por sus implicaciones éticas. ¿Cómo enseñar a una máquina a «pensar» éticamente? ¿Y quién decide quién vive y quién muere? Si bien este es un ejemplo obvio (e inminente), las preguntas éticas sobre la IA están a nuestro alrededor.

¿Por qué la ética es tan importante?

Las áreas en las que la IA nos beneficia más, también tienen el mayor potencial de daños. Tomemos la atención médica, una industria donde las decisiones no siempre son en blanco y negro. La IA está lejos de poder realizar diagnósticos complejos o replicar los «sentimientos viscerales» de un humano. Incluso si pudiera, ¿son éticos los médicos de IA? ¿Se podría capacitar a la IA para aumentar las ganancias a expensas del paciente? Y en el caso de negligencia profesional, ¿a quién demandaría el paciente? ¿El robot?

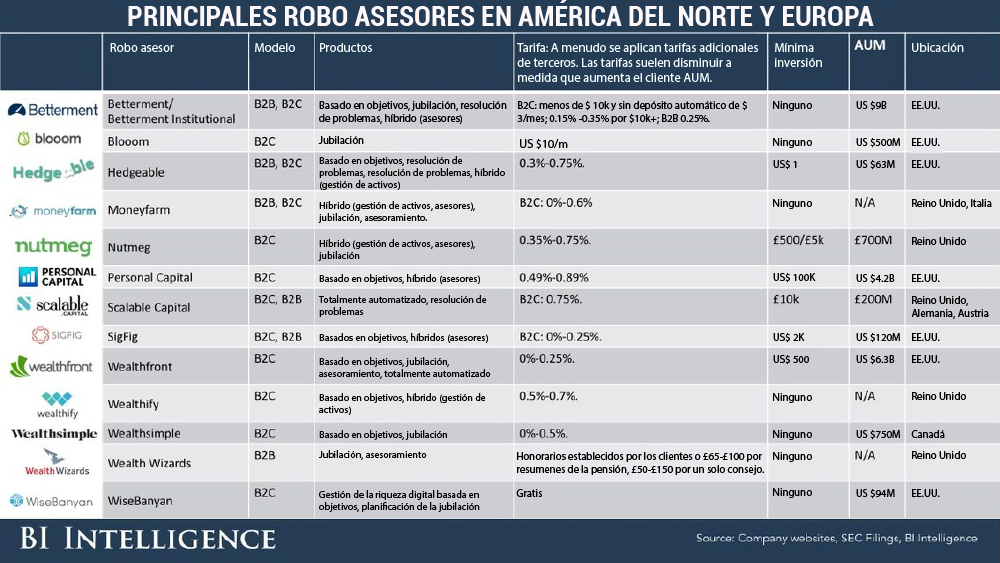

Se ha proyectado que la IA gestionará $ 1 trillón en activos para 2020. Al igual que en la atención médica, no todas las decisiones financieras se pueden tomar solo con lógica. Las variables que intervienen en la gestión de una cartera son complejas y un movimiento en falso podría llevar a millones en pérdidas. ¿Podría utilizarse la IA para explotar el comportamiento y los datos de los clientes? ¿Qué pasa con la piratería? ¿Confiarías en una máquina para administrar tu dinero?

Se ha proyectado que la IA gestionará $ 1 trillón en activos para 2020.

La guerra de la IA levanta las banderas éticas más preocupantes. «Entidades móviles inteligentes» totalmente autónomas están llegando y prometen cambiar la guerra como la conocemos. ¿Qué sucede cuando un misil de la IA comete un error? ¿Cuántos errores son “aceptables”?

Estas son las preguntas que me mantienen despierto por la noche. La buena noticia es que no es demasiado tarde; Solo hemos visto un atisbo de lo que es capaz de hacer la IA. La única manera de asegurarnos de que no creamos un monstruo que pueda volverse contra nosotros es incorporar salvaguardas éticas en la arquitectura de la IA que estamos creando hoy.

Aquí hay tres estrategias que cualquiera que actualmente construya IA debería considerar:

1. Traer a un humano a escenarios sensibles

En todos los escenarios anteriores, la pregunta sigue siendo: ¿cuándo y en qué medida traemos a un ser humano? Si bien no hay una respuesta definitiva, la IA que emplea un sistema de «human-in-the-loop» (HITL), donde las máquinas realizan el trabajo y los humanos asisten solo cuando hay incertidumbre, produce algoritmos más precisos. Si una máquina encuentra un conjunto de metadatos engañoso, podría aprender lecciones que un humano razonable evitaría.

El establecimiento de prácticas éticas en torno a los metadatos dará estructura al escenario HITL y posiblemente automatizará el «factor humano» a lo largo del tiempo. La conciencia humana y el código moral también deben codificarse como parte de los metadatos de la IA que impulsan las interacciones y, en ocasiones, las decisiones.

2. Coloque protecciones para que las máquinas puedan autocorregirse

Todos hemos leído sobre el problema de las falsas noticias de Facebook, pero el gigante de la tecnología ha sido atacado nuevamente una vez más, lo que lo ha llevado a eliminar más de 5,000 opciones de segmentación en su plataforma de anuncios que podrían usarse para discriminar a ciertas etnias y grupos religiosos. Este tipo de características éticas deberían integrarse idealmente a medida que se construye el producto, pero es mejor tarde que nunca.

Tuve la oportunidad de hacer esto de primera mano cuando BCG, BCG Digital Ventures y una compañía de Fortune 100 se asociaron para construir Formation, una plataforma de IA para experiencias personalizadas. Durante la creación del producto, implementamos medidas de seguridad en tres puntos de control para asegurarnos de que no violamos la confianza de los usuarios.

3. Crear un código de ética

Esto puede parecer obvio, pero te sorprenderán las pocas compañías que están haciendo esto. Ya sea sobre la privacidad de los datos, la personalización o el aprendizaje profundo, cada organización debe tener un conjunto de estándares con los que opera. Según el CEO de Apple, Tim Cook, «la mejor regulación es la autorregulación». Para Apple, esto significa examinar cuidadosamente cada aplicación en su plataforma para asegurarse de que no estén violando la privacidad de los usuarios.

Esta no es una solución de talla única; el código ético que promulgues debe ser dictado por la forma en que usas IA. Si su empresa rompe (o se aproxima) a un estándar, se debe alentar a los empleados a levantar la bandera y usted, como su líder, es responsable de tomar en serio estas preocupaciones.

Aquí hay algunas recomendaciones para crear un código de ética:

⦁ Cuando los datos personales están en juego, nos comprometemos a agregarlos y anonimizarlos lo mejor que podamos, tratando los datos de los consumidores como lo haríamos con los nuestros.

⦁ Nos comprometemos a aplicar salvaguardas a múltiples intervalos en el proceso para garantizar que la máquina no tome decisiones perjudiciales.

⦁ Nos comprometemos a volver a capacitar a todos los empleados que han sido desplazados por la IA en una función relacionada.

Como los arquitectos del futuro, tenemos la responsabilidad de construir tecnologías que mejoren las vidas humanas, no que las lastimen. Ahora tenemos la oportunidad de dar un paso atrás y entender realmente cómo estas decisiones de productos pueden afectar las vidas humanas. Al hacerlo, podemos convertirnos colectivamente en administradores de un futuro ético. Lampadia