Tras Mythos, un enfoque de no intervención ya no es políticamente viable ni estratégicamente prudente

The Economist

16 de abril de 2026

Narrado por IA

Traducido y glosado por Lampadia

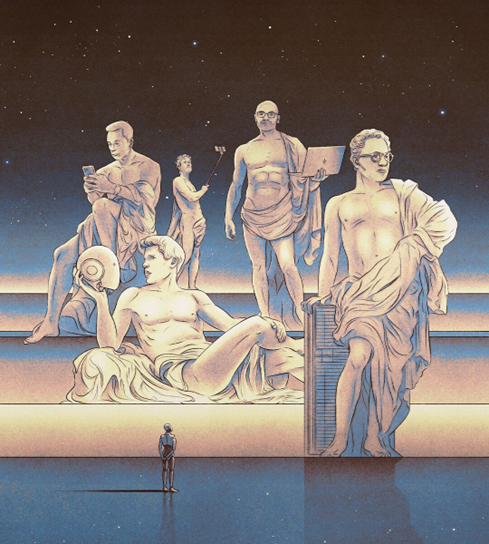

¿Debería confiarse a un puñado de hombres la tecnología más potente del mundo? Cinco genios tan famosos que se les puede identificar por su nombre de pila —Dario, Demis, Elon, Mark y Sam— ejercen un control casi divino sobre los modelos de inteligencia artificial que darán forma al futuro.

La administración Trump se ha mantenido al margen incluso cuando estos modelos han adquirido capacidades asombrosas, convencida de que la competencia sin restricciones entre empresas privadas es la mejor manera de asegurar que Estados Unidos gane la carrera de la IA contra China.

Ahora. De repente, el trato permisivo que Estados Unidos le daba a la IA parece estar llegando a su fin. La razón es que el vertiginoso progreso de estos modelos también repre senta una amenaza para la seguridad nacional estadounidense, lo que inquieta a miembros de la administración Trump, antes más preocupados por la sobrerregulación. Al mismo tiempo, el creciente resentimiento entre los votantes estadounidenses está convirtiendo a la IA en un foco de controversia política. Un enfoque de no intervención ya no es políticamente viable ni estratégicamente acertado.

El punto de inflexión fue el anuncio de Claude Mythos por parte de Anthropic el 7 de abril.

La última creación de este fabricante de modelos es tan sorprendentemente eficaz para detectar vulnerabilidades de software que, en manos equivocadas, podría poner en peligro infraestructuras críticas , desde bancos hasta hospitales. Los modelos de IA también plantean cada vez más otros riesgos, desde peligros para la bioseguridad hasta estafas a gran escala.

El director de Anthropic, Dario Amodei, consideró acertadamente que Mythos era demasiado peligroso para su distribución general. En su lugar, lo reservó para que lo utilizaran unas 50 grandes empresas de informática, software y finanzas, con el fin de reforzar sus sistemas de seguridad. El secretario del Tesoro estadounidense, Scott Bessent, estaba tan preocupado que convocó a los principales bancos a una reunión urgente.

No era la primera vez que la administración actuaba. Apenas unas semanas antes, el Pentágono intervino después de que el Sr. Amodei se negara a permitir que el modelo de Anthropic se utilizara en armas totalmente autónomas o para la vigilancia masiva interna. En aquella ocasión, la administración Trump también se alarmó, debido al poder que una sola empresa ejercía sobre una tecnología fundamental para la seguridad nacional.

La reacción negativa de los votantes aumentará la presión sobre la administración para que intervenga. Las encuestas de opinión llevan a cada vez más políticos a pensar que la IA será uno de los temas principales en las elecciones de 2028. Los estadounidenses son mucho más escépticos respecto a la IA que la gente de otros países. Siete de cada diez creen que la IA perjudicará las oportunidades laborales , un fuerte aumento con respecto al año anterior (y mucho antes de tener pruebas sólidas). La oposición ciudadana a los centros de datos está en auge, a pesar de que la IA tiene poco o nada que ver con el aumento de los precios de la electricidad.

Como muestra de la situación actual, la casa de Sam Altman, director de Open AI , ha sido atacada dos veces en los últimos días.

La historia sugiere que, con una tecnología tan transformadora como la IA , un momento de revelación era inevitable.

Desde John D. Rockefeller hasta Henry Ford, las grandes innovaciones industriales de Estados Unidos fueron lideradas por un pequeño grupo de hombres que alcanzaron un poder inmenso. Finalmente, los gobiernos del siglo XX intervinieron para controlar a las industrias demasiado poderosas, desde la disolución de monopolios que desmanteló Standard Oil hasta la creación de la Reserva Federal y la desintegración de AT & T . Aquellos tiempos fueron al menos tan polarizados y convulsos como los actuales. Y nuestros cálculos sugieren que los gigantes de la IA aún no son más dominantes que sus predecesores históricos.

Pero la historia también sugiere que controlar la IA será complicado. Esto se debe, en parte, a que las consecuencias de un posible fallo son muy graves. También se debe a que la IA está evolucionando a una velocidad vertiginosa.

Las disyuntivas son cruciales. El crecimiento económico se beneficiará de la rápida difusión de las ventajas de la IA , pero la posible reacción adversa podría fácilmente derivar en una excesiva regulación.

La inacción podría dejar a Estados Unidos vulnerable al caos provocado por la IA , pero un exceso de regulación garantizaría que China gane la carrera por la IA . Esto convierte este momento en una situación crítica.

El tiempo apremia. Hace dos años, durante la administracib ón Biden, los debates sobre la regulación se centraban principalmente en los riesgos potenciales de la IA . Hoy, sus capacidades son alarmantemente poderosas y aumentan con cada lanzamiento. El ritmo de la innovación implica que los debates sobre el papel adecuado del gobierno, que en el pasado se prolongaban durante años, incluso décadas, ahora deben resolverse en cuestión de meses.

Los obstáculos técnicos para un enfoque más intervencionista son enormes. Las herramientas de control gubernamental, como la nacionalización, son ineficaces porque los ingenieros talentosos pueden cambiar de empresa con facilidad y la capacidad de procesamiento informático es un bien escaso. Peor aún, los principales creadores de modelos solo llevan unos meses de ventaja a sus competidores de código abierto, incluidos los de China. Tarde o temprano, las capacidades de sus modelos estarán al alcance de todos .

Aun así, el momento decisivo podría ser cuando comience a gestarse un plan viable para controlar la IA . Los usuarios de confianza tendrían acceso anticipado a los modelos más potentes: OpenAI, siguiendo el ejemplo de Anthropic, está implementando su última herramienta para un grupo limitado de profesionales de ciberseguridad previamente seleccionados. Antes de permitir la comercialización generalizada de estos modelos, el gobierno podría exigir la certificación de organismos del sector que los hayan probado para diferentes usos.

Cuidado con los geeks con talento

Esta idea ofrece ventajas tanto para los grandes fabricantes de modelos como para el gobierno.

Evita el largo proceso de crear un nuevo organismo regulador.

Al permitir el acceso solo a unos pocos usuarios premium, los fabricantes de modelos pueden cobrar precios más altos y limitar el uso de la escasa capacidad de procesamiento. Mientras tanto, el gobierno puede restringir quién puede usar los modelos más potentes, reduciendo el riesgo de que China los copie y los alcance más rápidamente.

Pero también adolece de graves problemas.

El lanzamiento limitado reducirá la competencia y aumentará la influencia de las empresas de IA ya establecidas .

Ralentizará la difusión de los beneficios de la IA y creará un sistema de dos niveles dentro de la economía estadounidense, perjudicando a las numerosas empresas que se ven repetidamente privadas del acceso privilegiado y anticipado a nuevos modelos potentes.

¿Qué ocurre si crear mecanismos de defensa contra la IA lleva mucho tiempo o es imposible? ¿Y qué pasa con los modelos de código abierto? ¿Cómo se puede exigir que también cumplan estas normas?

Un sistema regulatorio basado en estos fundamentos podría resultar injusto. Quienes están dentro del sistema podrían protegerse de las amenazas externas; quienes están fuera tendrían que confiar en que todo saliera bien. Las oportunidades para el cabildeo y las ganancias desmesuradas serían inmensas. Esto pondría a prueba la honestidad y la competencia de la administración más abiertamente corrupta de la era política moderna estadounidense. Y una solución que concentre aún más el poder y la riqueza en un puñado de genios de la IA corre el riesgo de agravar la reacción política que empieza a preocupar a Washington.

Además, el enfoque de Mythos solo puede ser la mitad de la solución.

La seguridad de la IA no puede garantizarse a nivel nacional. Eventualmente, requerirá cooperación internacional, comenzando por China.

El nuevo enfoque en la ciberseguridad también debe ir acompañado de una reflexión urgente sobre los efectos económicos y sociales de la IA .

Abordar la disrupción del empleo y diseñar un sistema tributario adaptado a la IA que favorezca a los trabajadores son problemas enormes para los que aún nadie tiene buenas respuestas.

Esto debe cambiar. El momento Mythos es una llamada de atención sobre la seguridad de la IA . También exige una profunda reflexión en otras áreas.

Lampadia